引言:Scala在大数据时代的角色

Scala作为一门运行在JVM上的多范式编程语言,凭借其强大的函数式编程能力、简洁的语法以及对并发编程的天然支持,已成为大数据处理领域的重要工具。它与Apache Spark的深度集成,使得Scala成为大规模数据处理与存储任务的首选语言之一。本指南旨在为开发者提供Scala在数据处理与存储方面的核心知识与实践技巧。

一、Scala数据处理基础

1.1 核心数据结构

Scala提供了丰富且灵活的数据结构,它们是构建数据处理逻辑的基石。

- 集合框架:

List、Seq、Array、Set、Map等,支持不可变与可变版本,为数据处理提供了高性能的基础容器。 - 高阶函数与集合操作:

map、filter、flatMap、reduce、fold等函数是函数式数据转换的核心。它们鼓励声明式编程,使代码更简洁、易读且易于并行化。

val data = List(1, 2, 3, 4, 5)

val doubled = data.map(_ * 2) // 转换:List(2, 4, 6, 8, 10)

val evens = data.filter(_ % 2 == 0) // 过滤:List(2, 4)

val sum = data.reduce( + ) // 聚合:151.2 模式匹配

模式匹配是Scala的“杀手级”特性,能够优雅地解构和匹配复杂数据结构,极大地简化了数据清洗、分类和路由逻辑。

def processRecord(record: Any): String = record match {

case (id: Int, name: String) => s"ID: $id, Name: $name"

case list: List[_] => s"List with ${list.size} elements"

case _ => "Unknown format"

}1.3 隐式转换与类型类

通过隐式转换和类型类,可以优雅地为现有类型扩展数据处理能力,例如为自定义数据类型自动添加序列化、排序或聚合方法。

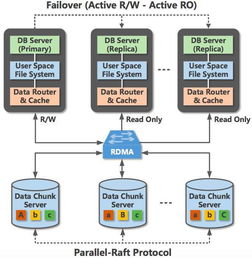

二、与Apache Spark集成进行大规模数据处理

Apache Spark是分布式数据处理的行业标准,其核心API正是用Scala编写的。

2.1 Spark核心概念

- RDD (弹性分布式数据集):Spark的底层抽象,代表一个不可变、可分区的数据集合。Scala的函数式风格与RDD的转换操作(如

map,filter)完美契合。 - DataFrame/Dataset:基于RDD构建的更高级别的抽象,提供了结构化数据的操作接口和Catalyst查询优化器。Dataset结合了RDD的类型安全与DataFrame的执行效率。

2.2 使用Scala编写Spark任务

`scala

import org.apache.spark.sql.SparkSession

val spark = SparkSession.builder.appName("ScalaDataProcessing").getOrCreate()

import spark.implicits._

// 读取数据

val df = spark.read.option("header", "true").csv("path/to/data.csv")

// 使用Scala进行数据转换与聚合

val result = df

.filter($"age" > 18) // 过滤

.groupBy($"department") // 分组

.agg(avg($"salary").as("avgsalary")) // 聚合

.orderBy($"avgsalary".desc) // 排序

// 写入存储

result.write.parquet("path/to/output.parquet")`

2.3 性能优化

- 合理分区:使用

repartition或coalesce优化数据分布。 - 广播变量与累加器:利用

broadcast变量高效分发大只读数据,使用累加器进行安全的全局聚合。 - 持久化策略:明智地使用

cache()或persist(),避免重复计算。

三、数据存储与交互

数据处理的结果最终需要持久化,Scala生态系统提供了多种方式与存储系统交互。

3.1 文件系统

- 本地/分布式文件系统:通过Spark API或标准Java/Scala IO库读写文本、CSV、JSON、Parquet、ORC等格式。Parquet因其列式存储和高效压缩,在大数据场景中尤为常用。

3.2 数据库

- 关系型数据库:使用JDBC通过Spark或独立的库(如Slick)进行连接和操作。

- NoSQL数据库:

- Cassandra:通过

spark-cassandra-connector库无缝集成,支持将DataFrame直接读写到Cassandra表。

- HBase:通过

Hadoop Input/OutputFormat或Apache HBase的Spark Connector进行操作。

- MongoDB:使用官方的MongoDB Spark Connector。

3.3 序列化与反序列化

高效的数据存储离不开序列化。除了Java序列化,Scala社区推荐:

- Kryo:速度快、序列化结果体积小,是Spark中默认推荐的序列化器(需注册自定义类)。

- Avro/Protobuf/Thrift:这些跨语言、带Schema的二进制格式,非常适合长期存储和跨系统数据交换。Scala有相应的开源库支持(如

avro4s,scalapb)。

四、最佳实践与架构建议

- 不变性与纯函数:尽可能使用不可变集合和纯函数,这能减少副作用,使代码更易于测试、推理和在分布式环境中运行。

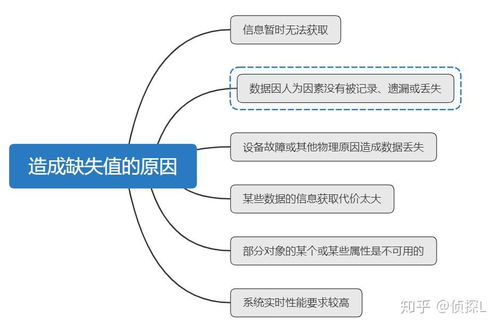

- 错误处理:善用

Option、Try、Either等Monadic类型来处理可能缺失或异常的数据,避免使用null。 - 资源管理:使用

Loan Pattern或Scala ARM(自动资源管理,如Using对象)确保文件句柄、数据库连接等资源被正确关闭。 - 模块化与组合:将复杂的数据管道拆分为小的、可组合的函数,利用Scala的面向对象和函数式特性构建清晰、可维护的架构。

- 测试:使用ScalaTest或Specs2为数据处理逻辑(特别是纯函数部分)编写单元测试,确保其正确性。

###

Scala凭借其强大的语言特性和与Spark等大数据框架的深度集成,为构建高效、可靠、易维护的大规模数据处理与存储系统提供了卓越的工具集。掌握Scala的函数式编程范式、集合操作以及与各种存储系统的交互方式,是成为一名高效大数据工程师的关键。随着项目复杂度的提升,Scala在类型安全、表达能力和并发模型方面的优势将愈发明显,助力应对日益增长的数据挑战。